Comment activer les fonctionnalités de Word ?

La fonction de correction automatique de Microsoft Word facilite votre travail en corrigeant automatiquement les fautes de frappe au fur…

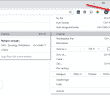

Comment désactiver Adblock sur mon ordinateur ?

Alors, comment désactiver le bloqueur de publicités ?Google Chrome a depuis longtemps un plugin qui a arrêté les publicités (Adblock) pour…

Une sélection de baies de brassage 12u : à quoi ça sert ?

À l’ère de la digitalisation, les supports numériques sont devenus indispensables dans les entreprises. L’utilisation d’objets connectés nécessite des équipements spécifiques. Parmi eux, les baies de brassage informatiques sont reconnues…

Fonction de la touche Shift sur le clavier : utilisation et astuces

La touche Shift, positionnée stratégiquement de chaque côté du clavier, est un outil essentiel pour la frappe au clavier. Sa…

Comment télécharger Teams sur Mac ?

Sorti en 2018, Among Us est rapidement devenu l’un des meilleurs jeux de société de l’été. Bien qu’il offre une…

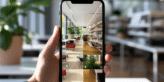

Comment pouvez-vous mettre des droits d’auteur sur leurs photos ?

Photos gratuites et photos qui coûtent cher Une grande ignorance des photos que l’on est autorisé à utiliser se produit…

Quelles sont les missions d’une entreprise développement web ?

Avec l’évolution de la technologie, la majorité des entités commerciales exploitent Internet pour assurer la distribution de leurs produits et…

Comment protéger son Wifi du piratage ?

De nos jours, avoir un réseau Wifi à sa disposition est une aubaine pour tous en raison de la connexion…